Un desarrollador utiliza la inteligencia artificial (IA) para crear mejor tecnología. Emplea algoritmos para procesar cientos de millones de datos y conseguir que la IA reconozca imágenes, voz o texto. Asimismo, en pocos segundos la IA detecta fallos que a un humano le tomaría meses identificar. Un proveedor de inteligencia artificial convierte la IA en un servicio tangible y listo para su uso. De esa forma emplea la IA para recomendar a sus clientes qué funciones de la nube o qué herramientas les convienen más, según su consumo. O predicen cuándo va a fallar un equipo antes de que pase, y así se garantiza la continuidad del servicio. Los clientes y usuarios de la IA implementan asistentes inteligentes para resolver dudas de sus compradores, en cualquier momento y a cualquier hora, sin intervención humana (como en el caso de los chatbots), para hacer análisis de mercado o resumir reuniones, redactar informes automáticos o clasificar facturas por cobrar. Pero ¿qué tan confiable es la IA? Esa aliada que nunca duerme y con la que puedes contar 24/7 se basa en algoritmos que necesitamos comprender. Después de todo, la IA puede contribuir en la toma de decisiones de los bancos – determina quién recibe un crédito -, de RR. HH. – a quién se contrata -, puede confirmar noticias en las redes sociales, entre otros. Para entender la inteligencia artificial, requerimos saber:

- Que se está interactuando con una IA y no con un humano.

- ¿Por qué la IA me dio determinada respuesta?

- ¿De dónde provienen los datos?

- ¿Quién tiene la responsabilidad, en el caso de que la información sea errónea o viole límites aceptables?

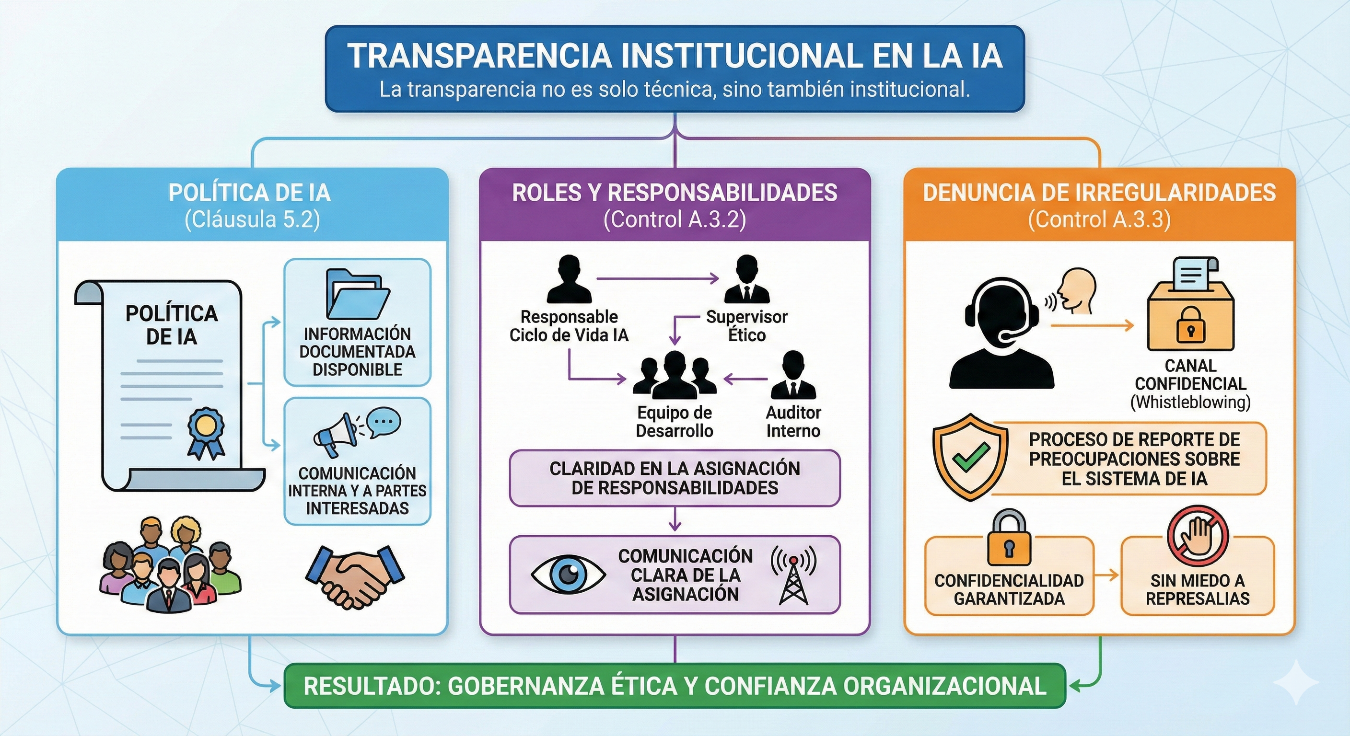

La transparencia propicia la innovación. Porque sin confianza, la gente no adopta la tecnología. En ese sentido, ISO/IEC 42001: 2023 – Sistemas de gestión de inteligencia artificial ayuda a que la organización no solo gestione riesgos e impactos, sino que hace saber que sus sistemas son comprensibles y auditables.

¿Qué entendemos por transparencia en la ISO/IEC 42001?

La norma define la transparencia y la explicabilidad (capacidad de explicar los resultados de la IA) como objetivos fundamentales para mitigar riesgos éticos y de seguridad. No se trata de publicar el código fuente, sino de una cualidad del sistema que permite que este sea interpretable y comprensible por todas las personas que interactúan con él a lo largo de su ciclo de vida.

El objetivo es doble:

1. Que los desarrolladores entiendan el funcionamiento interno (caja blanca).

2. Que los usuarios finales y afectados comprendan por qué el sistema tomó una decisión.

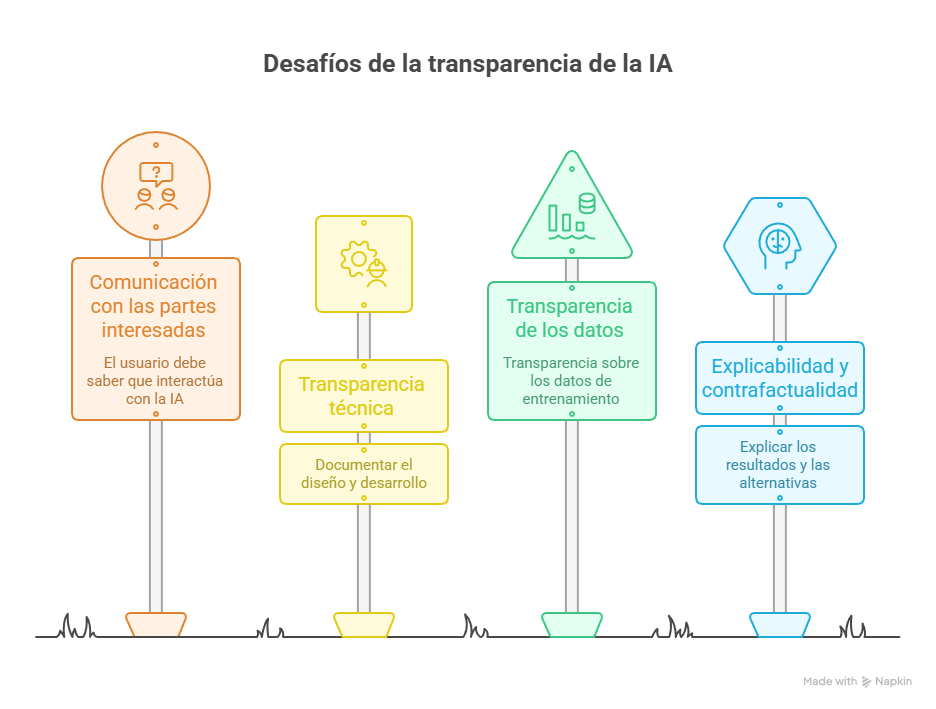

Los 4 pilares de la transparencia en la norma

Con el fin de cumplir con los controles del Anexo A de ISO/IEC 42001, la organización activa mecanismos en cuatro áreas clave:

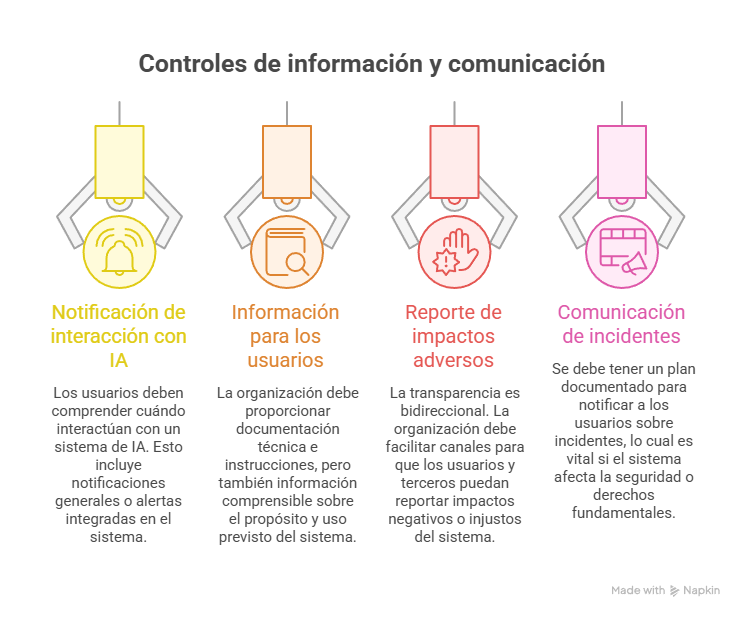

1. Comunicación con las partes interesadas (control A.8)

La norma es estricta: el usuario requiere saber que está interactuando con una IA. Además, la organización debe proporcionar información clara sobre:

• Propósito y limitaciones: ¿Para qué sirve el sistema y, más importante aún, para qué no sirve?

• Instrucciones de uso: Información concisa y accesible sobre cómo operar el sistema y cómo interpretar sus resultados.

• Canales de reporte: La organización facilita mecanismos para que los usuarios reporten impactos adversos o resultados injustos.

2. Transparencia técnica y del ciclo de vida (control A.6)

La norma exige la documentación rigurosa en el diseño y desarrollo. Esto incluye documentos técnicos adaptados a cada tipo de audiencia (reguladores, socios, usuarios). Un punto crítico es el registro de eventos (Logs), al igual que la caja negra de un avión, el sistema registra su actividad cuando está en uso para permitir la trazabilidad y entender qué ocurrió, en caso de incidente.

3. Transparencia de los datos (control A.7)

Dado que la inteligencia artificial es el reflejo de la información con que se nutre, ISO/IEC 42001 exige transparencia sobre los datos de entrenamiento, validación y prueba en cuanto a estos aspectos:

• Procedencia: Es crucial documentar el origen de los datos y su historial de modificaciones a lo largo del ciclo de vida.

• Calidad y sesgos: Informa sobre la representatividad de los datos para evitar sesgos discriminatorios que afecten la equidad del sistema.

4. Explicabilidad y contrafactualidad

Para sistemas complejos la norma sugiere el uso de técnicas que permitan explicar los resultados. Aquí entra en juego el concepto de contrafactualidad. Por ejemplo, en un banco no basta con concluir que el crédito fue denegado, el sistema debe ser capaz de indicar qué variables tomó en cuenta y qué debió ser diferente para que el resultado fuera positivo (ingresos 10% mayores).

Según las guías de aplicación vinculadas a la norma ISO/IEC 42001: 2023, para lograr esta transparencia se recomienda:

• Adaptar el lenguaje: No usar lenguaje técnico con el usuario final. La información puede ir de lo global a lo particular, para asegurar el entendimiento.

• Gestionar la complejidad: En fase de diseño, valora si un modelo más sencillo y transparente puede cumplir el objetivo de negocio tan eficazmente como uno complejo y opaco.

• Notificación de cambios: Si el sistema cambia o se actualiza, el usuario debe ser informado, especialmente si esto afecta la precisión o el comportamiento del software.

La norma ISO/IEC 42001:2023 aborda la transparencia como uno de los pilares fundamentales para la confianza en la IA. Reconoce explícitamente que la falta de transparencia y explicabilidad son características específicas de la IA que requieren salvaguardas distintas a las de los sistemas de tecnología de la información tradicionales.

La ISO/IEC 42001 vincula la transparencia directamente con la confianza y la rendición de cuentas. La falta de esta se identifica como una fuente de riesgo.

Si el sistema es una caja negra o si la organización opera de manera opaca, no es posible para las partes interesadas (usuarios, reguladores) evaluar si el sistema es justo, seguro o si cumple con las leyes y los Derechos Humanos. Por tanto, la norma exhorta a proporcionar la información necesaria para que estas partes puedan comprender y evaluar los riesgos y sus impactos.

0 comentarios