Al pensar en ciberseguridad surgen imágenes mentales de cifrado, contraseñas, firewalls, agentes de monitoreo… ¿Y la inteligencia artificial (IA)? De alguna forma damos por sentado que al utilizarla los datos están bien protegidos, al menos en términos tradicionales. Después de todo, la IA es inmediata, la interfaz se ve limpia (sin links ni anuncios) y carece de las típicas señales de alerta. Pero lo cierto es que la IA puede comprometer la seguridad al no regular los datos de entrada, aprender datos manipulados, generar malware, crear phishing hiperrealista, entre otros.

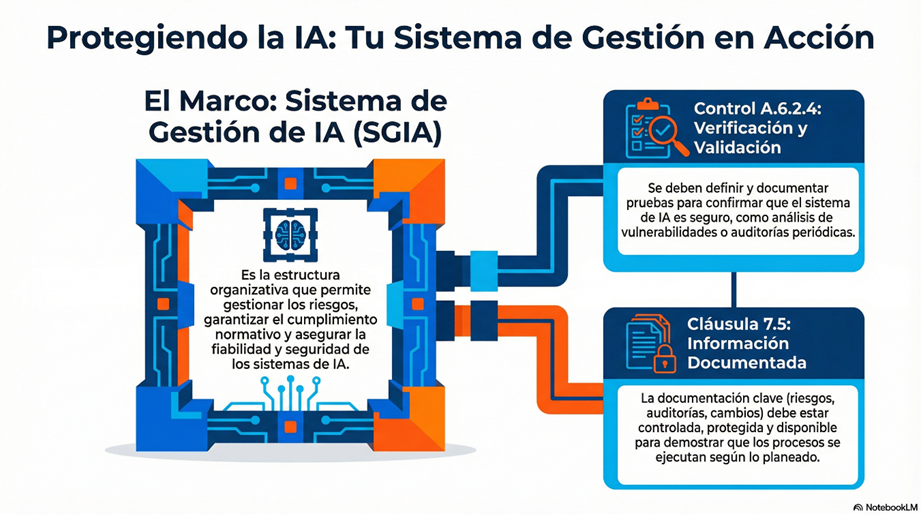

La norma ISO/IEC 42001:2023 – sistemas de gestión de inteligencia artificial (SGIA) y el marco regulatorio europeo (AI Act) redefinen la seguridad no solo como protección, sino como una garantía de solidez y continuidad operativa. Para las organizaciones, esto significa que proteger la información es tan vital como para una persona proteger la identidad o cuenta bancaria. ¿Cómo abordar la seguridad y la continuidad de negocio en la era de la IA? Te lo contamos aquí:

1. Refuerza la ciberseguridad tradicional

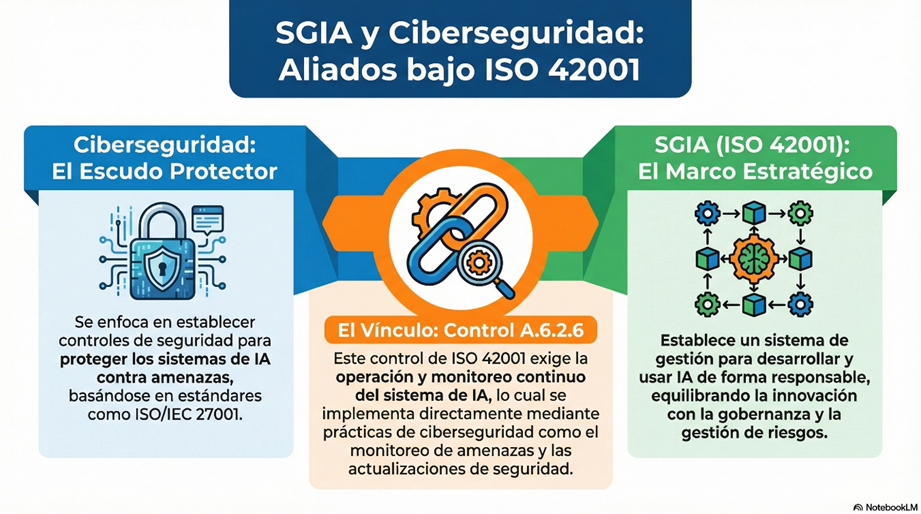

Cuando creíamos que con ISO/IEC 27001 era suficiente, nos cambiaron las reglas de juego. Este estándar solo ya no basta. ISO/IEC 42001 advierte que la IA introduce nuevos problemas de seguridad que van más allá de las preocupaciones clásicas de tecnología de la información (TI). La guía de ciberseguridad vinculada a la norma aclara la importancia de abordar la seguridad en todas las etapas del ciclo de vida: diseño, obtención de datos, entrenamiento y despliegue.

2. ¿Nuevas amenazas de interrupción? ¡Nuevas estrategias de continuidad!

Para garantizar que el negocio no se detenga, la norma ISO/IEC 42001 resalta la necesidad de gestionar riesgos que son invisibles para los controles tradicionales. Según las guías técnicas, las amenazas críticas que pueden interrumpir la operación en una IA incluyen:

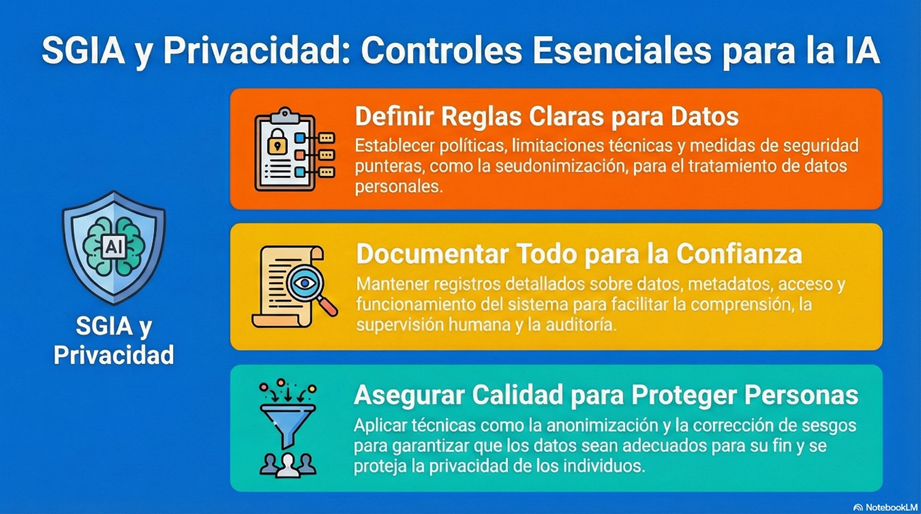

- Envenenamiento de datos: ocurre cuando en la fase de entrenamiento un atacante introduce datos maliciosos para que el modelo aprenda comportamientos erróneos. La consecuencia es que el sistema queda inutilizado desde su origen, toma decisiones incorrectas que pueden obligar a detener el servicio y reentrenar el modelo desde cero. La solución que plantea ISO/IEC 42001 es la implementación de controles estrictos sobre la procedencia y limpieza de los datos de entrenamiento y control de versiones de los datasets.

- Ataques de evasión y adversarios: sucede cuando durante el uso de la IA se manipulan sutilmente los datos de entrada para engañar al modelo y forzar un error. De esta manera el servicio se vuelve inestable o peligroso, la confianza del cliente se ve afectada y la organización podría enfrentar sanciones legales. En este sentido, la norma ISO/IEC 42001 exige pruebas de robustez y monitorización continua para detectar entradas anómalas, diseñadas para explorar los límites del modelo.

- Robo del modelo. Entrenar una inteligencia artificial es costoso. Por eso el modelo es un activo crítico de propiedad intelectual. Los ataques de extracción intentan replicar el modelo al consultar su API repetidamente. El impacto en la continuidad es tan negativo que existe pérdida de ventaja competitiva y exposición de secretos comerciales.

3. Gestión de incidentes graves: la respuesta ante la crisis

La continuidad de negocio depende de la capacidad de reacción. El Reglamento de IA, en su artículo 73, y la Guía de gestión de incidentes exigen que los proveedores establezcan un sistema para notificar incidentes graves. Los plazos son estrictos y van desde los 2 días para infraestructuras críticas, hasta 15 días para otros casos. Por eso es relevante contar con un sistema de gestión de inteligencia artificial, y más valioso aún es contar con un sistema de gestión integrado, con el propósito de no improvisar cuando la IA falla.

En general, los tres pilares que garantizan la continuidad de la operación de una IA frente a incidentes son:

- Precisión: Que el sistema acierte en sus predicciones.

- Solidez: La capacidad del sistema de mantener su nivel de rendimiento bajo condiciones imprevistas o ante datos nuevos.

- Ciberseguridad: La protección contra intentos de terceros de alterar el uso, los resultados o el funcionamiento del sistema.

4. Definamos roles concretos y trabajemos con base en ello

La responsabilidad de la seguridad y continuidad recae en todo el equipo de trabajo, es una tarea de todos. Pero, pese a que se comparta, no es igual para todos. Cada uno contribuye desde su rol:

• El proveedor: Es responsable de diseñar el sistema con seguridad por diseño. Le compete hacer pruebas automatizadas de vulnerabilidades (SAST/DAST) específicas para IA. También es parte de su labor entregar instrucciones claras sobre cómo operar el sistema de forma segura.

• El usuario: Su rol en la continuidad consiste en garantizar que el sistema se use según las instrucciones del proveedor. Entre sus tareas figuran aplicar los parches o actualizaciones de seguridad que envíe el proveedor, cuando aplique, y capacitar a su personal para no introducir datos que comprometan el sistema.

Implementar la norma ISO/IEC 42001 contribuye a que la IA, nuestro nuevo y preciado cerebro digital, no sea manipulado. Como señala la guía para empresas australianas, la certificación actúa como una marca de confianza, demuestra a clientes y socios que la organización tiene controles robustos para evitar que la IA se convierta en un pasivo legal o financiero. Si de ahora en adelante la IA toma decisiones críticas, la seguridad en esta es la base de la continuidad.

0 comentarios